全红婵、孙颖莎、王楚钦成受害者!最新曝光

杭州网 发布时间:2025-08-19 10:53

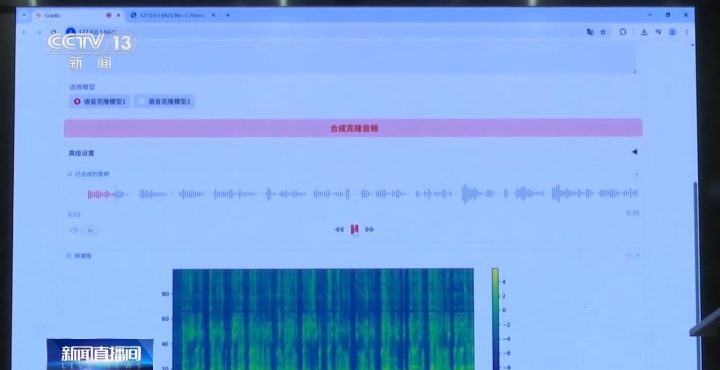

一键盗声仅需十几秒 AI技术应做具体限制

有人为自己的权益被侵犯而困扰,侵权者却滥用AI技术违法牟利。那么,AI克隆声音是如何实现以假乱真的?又是谁在为“盗取声音”而推波助澜?

记者调查发现,在抖音、快手等网络平台上,以“声音克隆”为关键词进行搜索,能轻易找到大量相关教程视频和软件下载信息。部分博主不仅详细演示操作过程,还直接提供软件资源。

网络安全专家潘季明介绍,基于开源的语音大模型,只需一段清晰的语音样本,任何人的声音都可能在极短时间内被克隆,并能被操纵说出攻击者设定的任意内容。

AI克隆声音最大隐患是被诈骗分子利用

据潘季明介绍,除了侵犯声音权等合法权益,AI克隆声音目前最大的隐患是被诈骗分子利用,一旦与AI换脸等技术结合,生成高度逼真的“数字人”实施诈骗,危害将非常严重。潘季明建议,目前相关的技术要从源头进行相应限制。

网络安全专家 潘季明:在开源的过程当中,我们可能需要对这些开源代码做一些使用层面上的限制,包括使用时长、应用场景上,也需要做一些具体的应用限制。

(原标题:全红婵、孙颖莎、王楚钦成受害者!最新曝光)

来源:央视新闻 作者: 编辑:陈周滢

返回