“第44天。”6月12日,配音演员林景登录微博,敲下一行字。一个多月前,他点开朋友发过来的链接,吃惊地发现AI科幻广播剧《异世界的甜甜圈》开头那段声音,同自己有八分相似。他怀疑有人可能未经授权,便拿他的声音“喂”了AI。

无独有偶,不久前,浙江先施律师事务所受曾为《回家的诱惑》《楚乔传》等剧目配音的知名配音演员委托,指派林一冲律师向盗用声音等素材制作并传播AI视频的创作者,发出律师函,后者在各大平台下架相关视频。

在AI浪潮席卷下,配音行业正在面临全新的挑战:一些从业者的声音被“偷”走投喂给AI,然后抢走原本属于他们的工作。

国内外多位配音演员公开维权

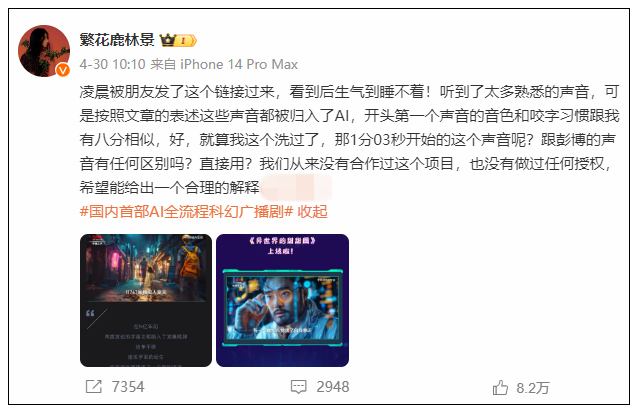

“凌晨朋友发了这个链接过来,听完后气到睡不着!听到了太多熟悉的声音,可是按照文章的表述这些声音都被归入AI。开头第一个声音的音色和咬字习惯跟我有八分相似,好,就算我这个洗过了,那1分03秒开始的这个声音呢?跟彭博的声音有任何区别吗?”

林景和彭博的微博维权之旅从4月30日开始。他们曾各自为《王者荣耀》中的云中君、《原神》中的钟离等游戏角色配音,在业内也小有名气。两人前往公证处录屏留存发布账号、发布内容等证据,并进行公证,做了最终诉诸司法的准备。

直到今天,林景都会雷打不动地发一条+1的微博,试图用舆论给予对方压力。这些日子里,评论区也逐渐聚起了一些声援的配音演员,反对AI侵犯从业者的权益。

配音演员洪海天写道:“有没有这样一种可能性:以后任何公司和个人对于人声的使用(包括AI采样)都要能说得清楚声音数据的来源;每个声音数据都必须标注劳动者的名字并且获得劳动者的授权。”

面对来势汹汹的AI和道德风险,类似的剧情正在国外上演。

近日,美国两名配音演员保罗·勒曼和琳娜·塞奇对AI初创公司Lovo提起诉讼,指控该公司在未经自己允许的情况下,用AI“复制”了他们的声音。

4年前,勒曼以1200美元的酬劳,在零工网站上提供了一次性的语音样本,“仅限用于学术研究目的”。可最近,他却在一档节目中听到了自己的“声音”正在解说。塞奇的境遇如出一辙,她当时拿到了400美元,制作广告测试脚本。

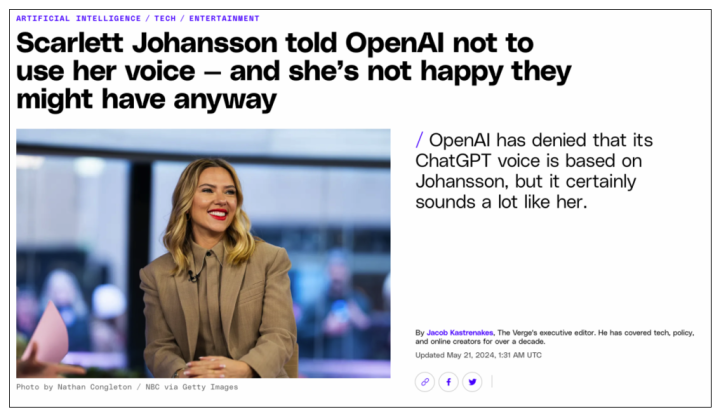

漫威超英“黑寡妇”的扮演者斯嘉丽·约翰逊也未能幸免。上月中旬,当OpenAI因GPT-4o而再次引发全球关注时,她一纸声明,控诉ChatGPT非法使用自己的声音,要求下架语音。

目前,OpenAI已暂停使用这款AI声音模板。

他们的声音正在被“偷”走

“我们这种网上声音工作者,还有视频博主,都是高危人群。”在刷到林景的微博后,小默忍不住感慨。从媒体转行,她已在杭州干了近10年有声书主播,见到过一些针对“声音偷窃”设下的“陷阱”。

“有的活行价就在300元左右,即使声音再好,也不可能翻倍。但有些公司突然给出800元,当中很可能就有猫腻。”她说的猫腻,指的是合同里的“隐藏条款”,比如在权责部分,藏在大堆关于版权的说明里,有一行小字,提到授权声音制作使用等说法,但不会直接出现AI等字眼。

这种情况变多,也和AI生成一个人的声音技术门槛越来越低有关。

3年前,剪映开始推出多种音色的文本朗读,今年初又上线克隆音色功能;番茄小说、喜马拉雅的AI有声小说,也做得有声有色。

真人有声书、AI有声书

“这些元素其实是glam rock(笑),然后加这种bling的感觉(笑),我觉得像这个衣服有一些jacket,比如说那个oversized的jacket,我觉得我是可以offduty的model。”

就在近日,一款名为ChatTTS的文本转语音工具火爆出圈。只要你输入文字,无论中文、英语还是双语混搭,它都能以不同音色读出来,还会自动加上口语化的连词,会笑、会停顿,甚至能模仿口头禅。

“定制高质量的AI声音模型,需要一两个小时的语音素材,训练一两天。”长音频AIGC平台“呱呱有声”业务负责人张政鹏表示。它背后的灵伴智能,从2016年开始专注于智能语音相关的AI技术研发和落地。而完成普通品质的AI声音模型,仅需几分钟素材,“合成效果能做到一定程度与原始说话人相似,但很难用于高标准的有声作品制作场景。”

声音和肖像一样具有人格属性

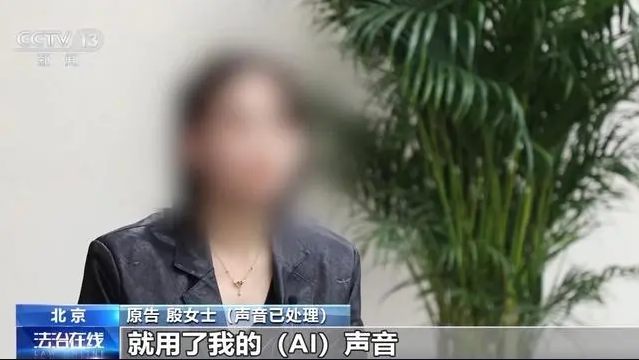

一位配音演员意外发现,自己的声音被AI化后,在一款App上以文本转语音产品的形式对外出售。她随即起诉至北京互联网法院。

视频截图

4月23日,一审判决,被告方使用原告声音、开发案涉AI文本转语音产品未获得合法授权,构成侵权,书面赔礼道歉,并赔偿原告各项损失25万元。

作为全国首例AI生成声音人格权侵权案,在尚未出台相关详细指导规定的背景下,这起案例的宣判具有开创性的示范效应。当时,法院认为声音作为一种人格权益,具有人身专属性,任何自然人的声音均应受到法律的保护。

《中华人民共和国民法典》第1023条第二款规定,“对自然人声音的保护,参照适用肖像权保护的有关规定。”浙江先施律师事务所主任郑筠律师解释:“法律条文的表述是‘参照适用’而不是直接适用,是因为声音不是一种具体的人格权,无法完全适用肖像保护的规则。”

那么,如何界定是否侵权?

“在法律上,主要看被控侵权的声音是否具有可识别性。比如,公众能识别出被控侵权的声音属于某知名配音演员,或足以造成相关公众产生混淆,则可能构成侵权。”郑筠透露,可识别性与声音权人的知名度密切相关,声纹对比是鉴别手段之一,“如果有80%以上的相同或近似,就有可能被司法机关认定构成实质性相似,进而认定侵权。”

“如果你觉得自己的声音可能正在遭遇侵权,应当及时取证,取证方式包括但不限于录屏、截图、公证录屏及截图等手段。”林一冲律师补充建议,“在律师的专业指导下,可以更好地完成取证及一切维权救济手段。”

此外,在两位律师看来,随着社会经济生活的发展和对人格权的日益重视,将声音权作为具体人格权进行保护,会是我国民法未来的发展趋势。

学习与AI共处

在一些配音演员因亲身经历或听到、看到不当使用AI,感到不安甚至是愤怒时,这个行业里,也有人伸出双臂主动拥抱技术,试图打破边界。

4月24日,配音演员赵乾景将声音授权给AI有声剧《凡人修仙传》,用于训练多音色AI人声,引起轩然大波。有人认为AI的介入是大势所趋,也有人觉得这是对配音艺术的践踏,挤压新人配音员的生存空间。

现阶段,“成熟的配音员和演播,一般不愿意把声音制作成AI,尤其是大咖。”小默说,更乐于授权AI采样的,通常是声音好听的新人,没什么经验和技巧,但有辨识度。

业界通行的做法,有一次性买断、分成使用(使用AI化声音的人越多,当事配音员分到的钱就越多)两类。

前不久,小默将儿子的声音授权给一家公司,一次性买断3万元。“已经制作成AI声音,应用场景类似于点读机,可选甜美女声、大气男声、男/女童音等。”小男孩就快进入变声期,留下这个奶声奶气的声音,对他来说也是种纪念。“等到成年,声音早就变了,不会影响他从事这一行。”

提起AI技术,小默坦言,多少有点“狼来了”的忐忑感,但她和一些同行都清楚地知道, “由不得我们接不接受,只能不断学习,积极应对。”空下来时,她会向一些公司了解AI语音制作,尝试用它做一些辅助工作。

张政鹏告诉她,AI声音的效果一直在提高,很多普通演播任务已基本可用,但在复杂的情感理解和表演方面,与真人还有较大差距。

而几次亲身体验,也让她稍稍放宽了心:“成熟的配音演员 和主播,通常会有独特的风格,也会根据情节文笔的不同,调节情绪、节奏等。”这些细微差别和情感传递,AI目前无法复制。“精品还需要真人,无法替代。而在辅助录制方面,比如画本、对轨等,AI错误率眼下还挺高,需要人工检查调整。”整个行业,仍在摸索和调整期。